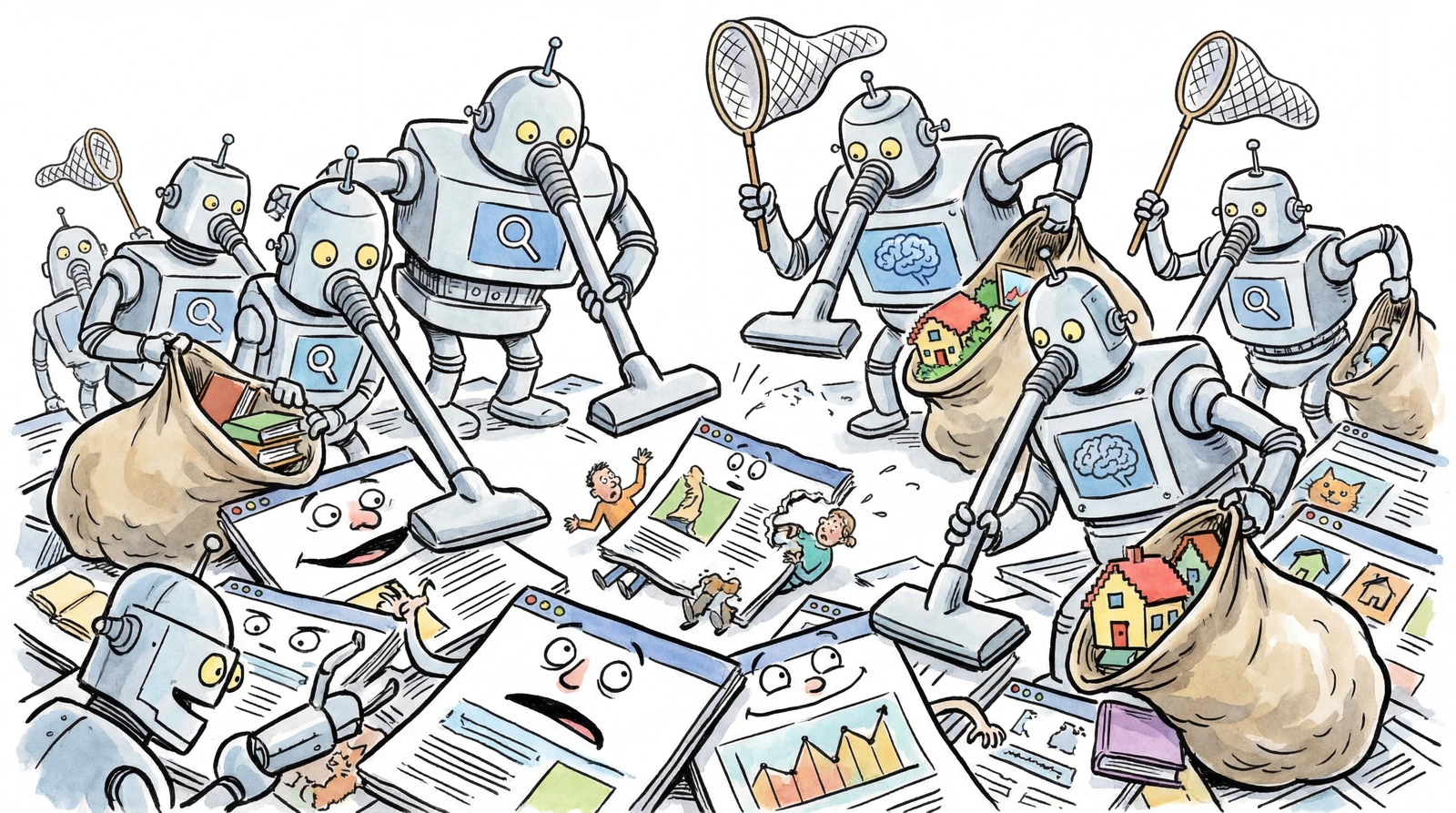

知らないうちに、AIがあなたのサイトを読んでいたら?

Googleで検索すると、Webサイトが表示されますよね?

それはGoogleが**自動プログラム(=ボット)を送り込み、Webサイトの情報をあらかじめ読み込んでいるからです。

このようにボットがWebサイトを巡回してコンテンツを収集する仕組みをクローリング(Crawling)**と呼びます。

ところが最近は検索エンジンだけでなく、ChatGPT・Gemini・Claudeといった生成AIまでもがWebサイトを訪問し、あなたの同意なしにコンテンツを持ち去っています。

このガイドでは、クローリングの仕組みから、それをコントロールする3つの方法、そして逆にAIに自分のコンテンツをもっと引用してもらうためのGEO戦略まで、一緒に学んでいきましょう。

list目次expand_more

- 1. クローリングってなに?

- 1-1. 検索エンジンのクローリングの仕組み

- 1-2. AIボットのクローリング、何が違うの?

- 2. クローリングをコントロールする3つのツール

- 2-1. robots.txt:入場ルール

- 2-2. ai.txt:AI向け利用案内

- 2-3. llms.txt:AIのためのサイト案内書

- 3. それぞれの比較

- 4. このルール、本当に守られるの?

- 4-1. 誰が守って、誰が無視するのか?

- 4-2. 法的な保護はどこまで進んでいるの?

- 4-3. では、どう備えればいいの?

- 5. 私のサイト、AIにすでにスキャンされている?確認する5つの方法

- ① サーバーログ(アクセスログ)の分析

- ② AIに直接聞いてみる

- ③ オンラインのクローラーアクセス検査ツール

- ④ 公開学習データセットで自分のサイトを検索

- ⑤ 行動ベースのボット検知

- 6. 実践チェックリスト

- Step 1:AI利用方針の整理

- Step 2:ai.txtの作成とアップロード

- Step 3:llms.txtの作成とアップロード

- Step 4:定期的な更新プロセス

- 7. GEO(Generative Engine Optimization)基礎

- 7-1. GEOとは?

- 7-2. SEO vs GEO の核心的な違い

- 7-3. AIが「良いコンテンツ」と判断する基準

- 7-4. GEOの核心戦略

- 今日のまとめ

1. クローリングってなに?

クローリングとは、検索エンジンやAIボットがWebサイトを自動で訪問し、ページの内容を読み取って保存するプロセスです。

NOTE

なぜクローリングが必要なの?

Webサイトを作っても、自動的にGoogleに表示されるわけではありません。

図書館の司書が新しい本を探し回るイメージに近いです。

- 世界には数十億のWebページがありますが、検索エンジンはその存在を自然には知ることができません。

- そこで検索エンジンはクローラー(ボット)という自動プログラムを送り、Webサイトを訪問してコンテンツを読み取ります。

- 読み取った内容を図書館の目録カードのようにインデックス(Index)として保存します。

- 誰かが検索すると、インデックスに保存されたページの中から最も関連性の高いものを選んで表示します。

つまり、検索エンジンにクローリングされていないページ=図書館の目録にない本=誰にも見つけてもらえないページなのです。

1-1. 検索エンジンのクローリングの仕組み

-

発見(Discovery):検索エンジンのボット(Googlebotなど)がリンクをたどって新しいページを発見

-

収集(Crawling):ページのHTML・テキスト・画像などのコンテンツを読み取る

-

インデックス(Indexing):収集した内容を分析・保存し、検索できる状態にする

-

表示(Ranking):ユーザーが検索すると、関連性・信頼性に応じて順位をつけて結果に表示

1-2. AIボットのクローリング、何が違うの?

ChatGPT・Gemini・Perplexityのような生成AIは、従来の検索エンジンとは異なる方法でWebコンテンツを活用しています。

| 項目 | 検索エンジン | 生成AI |

|---|---|---|

| 目的 | ページをインデックス → リンク一覧として提供 | コンテンツを学習・要約 → 直接回答を生成 |

| ユーザーの行動 | 検索結果をクリック → サイトを訪問 | AIの回答で解決 → サイトを訪問しないことも |

| ボットの種類 | Googlebot、Bingbotなど | GPTBot、ClaudeBot、Google-Extendedなど |

| 訪問頻度 | 安定している | 年々急速に増加中 |

NOTE

KNOW ー なぜこれを知る必要があるの?

いまやWebサイト運営者は「自分のコンテンツをAIが学習に使ってもいいのか?」という問いに答えなければなりません。

EUはすでに、著作権者が「私のコンテンツをAI学習に使わないでください」と拒否できる権利を法律で保障し始めており、この流れは世界中に広がっています。

2. クローリングをコントロールする3つのツール

2-1. robots.txt:入場ルール

-

場所:

https://あなたのドメイン/robots.txt -

対象:検索エンジン、一般クローラー、一部のAIボット

-

役割:「誰がどこまで入ってもいいか」を定める入場ルール

-

標準化:古くからあるWeb標準。最も広く使われている

基本の書き方:

User-agent: * # すべてのクローラーに適用

Allow: /blog/ # /blog/ パスのクローリングを許可

Disallow: /admin/ # /admin/ パスのクローリングを拒否

User-agent: GPTBot # OpenAIのボットだけ個別に制御

Disallow: / # GPTBot を全面ブロック

Sitemap: https://example.com/sitemap.xml

ポイント:

-

AIボットごとに個別制御が可能(GPTBot、ClaudeBot、Google-Extendedなど)

-

Disallow: /→ そのボットのクローリングを全面ブロック -

Allow: /→ 全面許可 -

クローリング制御の最も基本的な手段

2-2. ai.txt:AI向け利用案内

-

場所:

https://あなたのドメイン/ai.txt -

対象:AIクローラー、AIエージェント

-

役割:「AIが私たちのコンテンツをどんな用途・範囲で使ってもいいか」を説明する

-

標準化:まだ公式標準ではなく、提案・実験段階

ai.txtで制御できること:

- 許可・拒否の範囲

- 公開ブログ・ヘルプセンター → AI要約・検索・回答生成への活用を許可

- 有料講座・会員限定コンテンツ → AI学習・要約を禁止

- 優先参照データのパス

Sitemap・Data-Format・API-SearchなどでAIが効率よく読めるパスを案内

- ポリシー文(Policy)

- 人が読んでも理解できるAI利用原則(法務・ブランド基準)

作成例:

# ai.txt for example.com

# Last-Updated: 2026-03-26

User-Agent: *

Allow: /blog/

Allow: /docs/

Allow: /help/

Disallow: /members/

Disallow: /billing/

Sitemap: https://example.com/sitemap.xml

# Policy:

# - 公開ブログ・ドキュメント・ヘルプセンターはインデックス・検索・要約・Q&A回答への利用を許可します。

# - 会員限定ページおよびユーザーデータはモデル学習・AI生成回答への利用を禁じます。

ai.txtが特に重要なサイト:

-

有料・専門コンテンツが多いサイト(講座・レポートなど)

-

会員が多く投稿するコミュニティ型サービス

-

法務・政策リスクが高いサービス(金融・医療・教育・公共)

2-3. llms.txt:AIのためのサイト案内書

-

場所:

https://あなたのドメイン/llms.txt -

対象:LLM(ChatGPTなど)が回答生成時に参照

-

役割:「AIが回答するとき、どのドキュメントを最初に読むべきか」を案内する要約・索引

-

形式:Markdown

-

標準化:データサイエンティストのJeremy Howardが提案した llmstxt.org の非公式標準。急速に普及中

llms.txtの構成:

-

#H1見出し(サイト・サービス名) -

>Blockquoteで2〜3行のサマリー -

通常の段落でサービス説明

-

##セクション別に重要ドキュメントのリンク

作成例:

# KnowAI

> KnowAI はAI教育・コンサルティングのプラットフォームです。

> このファイルはLLMが重要なリソースを見つけ、

> 正確に回答するための案内です。

Last-Updated: 2026-03-26

## ドキュメント

- [はじめ方](https://knowai.com/docs/start): サービス概要と始め方

- [機能紹介](https://knowai.com/docs/features): 主要機能の説明

- [よくある質問](https://knowai.com/docs/faq): FAQ

## ブログ

- [記事一覧](https://knowai.com/blog): AI活用のヒントとトレンド

## ポリシー

- [利用規約](https://knowai.com/terms)

- [プライバシーポリシー](https://knowai.com/privacy)

llms.txt 作成チェックポイント:

-

H1見出しがあるか

-

Blockquote形式の短いサマリーがあるか

-

重要ドキュメントのリンクがリスト形式で整理されているか

-

すべてのURLが実際に開けるか(404がないか)

3. それぞれの比較

| 項目 | robots.txt | ai.txt | llms.txt |

|---|---|---|---|

| 例え | 🚧 入場ルール | 📋 利用案内 | 📖 重要ドキュメント案内書 |

| 主な対象 | 検索エンジンボット、一部AIボット | AIクローラー専用 | LLM(回答生成時) |

| 目的 | ボットの入場許可・拒否 | AI学習・要約の用途と範囲を明示 | AIが優先参照すべきドキュメントリストを提供 |

| 形式 | テキスト・ルールベース | テキスト・ルール+メタ情報 | Markdown |

| 標準化 | ✅ 古くからあるWeb標準 | ⚠️ 実験段階 | ⚠️ 非公式標準(急速に普及中) |

4. このルール、本当に守られるの?

上記の3つのファイルはすべて「自発的な遵守」を前提としています。つまり、技術的にアクセスをブロックする仕組みではなく、「うちのルールはこうです」と張り紙をする案内文に近いものです。

CAUTION

2025年、米国の裁判所(Ziff Davis v. OpenAI)はrobots.txtについてこう判断しました。

「robots.txtは芝生に立てた『立入禁止』の看板と同じだ。アクセスを実際に制御する技術的な仕組みではなく、訪問者が自分で守ることを期待するお願いにすぎない。」

つまり、AIボットがこの要請を無視しても、現在の米国法上はハッキング(DMCA違反)とはみなしにくい、というのが裁判所の立場です。

4-1. 誰が守って、誰が無視するのか?

| 区分 | 概ね遵守 | 無視の事例が報告されている |

|---|---|---|

| 主な業者 | Googlebot・GPTBot(OpenAI)・ClaudeBot(Anthropic)などの大手はrobots.txtを概ね尊重 | 一部のAIスタートアップや小規模クローラーはrobots.txtを無視して無断収集 |

| 問題点 | 公式ボット名を使用しているため識別可能 | ボット名を偽装したり身元を隠すクローラーが存在し、ブロック自体が難しい |

-

NPR(2024年)は「AIクローラーがインターネットの基本ルールを無視して暴走している」と報道

-

Cloudflareは2024年7月に「AIスクレイパー・クローラー」ワンクリックブロック機能をリリース。robots.txtを無視するボットも技術的にブロックできるようになった

4-2. 法的な保護はどこまで進んでいるの?

| 地域 | 現在の状況 |

|---|---|

| 🇪🇺 EU | DSM指令第4条:著作権者がrobots.txtなどで「AI学習に使わないでください」と明示的に拒否すれば法的効力を認める。EU AI Act(2024年制定)により2025年8月からGPAI(汎用AI)提供者は機械判読可能な形式のオプトアウト(事後拒否)を義務的に遵守しなければならない |

| 🇺🇸 米国 | 連邦統一法なし。裁判所はrobots.txtを技術的保護措置として認めなかったが、著作権侵害・契約違反などの別の法理で訴訟が進行中(NYT v. OpenAI、Reddit v. Anthropicなど) |

| 🇰🇷 韓国 | AI基本法(2026年1月施行)で高リスクAI規制・説明義務を導入。クローリング自体に関する明示的な規定はまだ不十分だが、著作権法違反の観点からアプローチ可能 |

| 🇯🇵 日本 | 著作権法第30条の4でAI学習用データの活用を広く認める一方、「著作権者の利益を不当に害する場合」は除外。日本独自の解釈が続いており、引き続き動向注視が必要 |

4-3. では、どう備えればいいの?

NOTE

実質的な防御=いくつもの層で守りを固めること

- robots.txt+ai.txt+llms.txt:最低限の「意思表示」(法的紛争の際に証拠になる)

- 利用規約にAIクローリング禁止を明記:契約違反として法的根拠を確保

- WAF(Webアプリケーションファイアウォール)ルール:Cloudflareなどで AIボットを技術的にブロック

- ログ監視:どのボットがアクセスしているかを追跡・記録

- ライセンス契約:大手AI企業とコンテンツ利用契約を締結(Reddit-Googleの事例など)

robots.txtだけでは不十分です。でも「何もしないこと」と「明確に拒否の意思を示すこと」は、法的に全く異なる立場に置かれます。特にEUではすでに法的効力が認められています。

5. 私のサイト、AIにすでにスキャンされている?確認する5つの方法

robots.txtで「入ってこないでください」と書いておくのは、これからのクローリングを防ぐためです。では、すでに起きてしまったクローリングや学習はどうやって知ることができるでしょうか?個人や小規模チームでも実践できる確認方法をまとめました。

① サーバーログ(アクセスログ)の分析

-

難易度:⭐⭐(基本的なサーバー知識が必要)

-

コスト:無料

-

最も基本的で確実な方法です。

Webサーバー(Apache、Nginxなど)のアクセスログには、どのボットが、いつ、どのページを訪問したかが記録されています。

確認すべきUser-Agentリスト:

| ボット名 | 運営元 | 目的 |

|---|---|---|

GPTBot | OpenAI | 学習データの収集 |

ChatGPT-User | OpenAI | リアルタイム検索・ブラウジング |

ClaudeBot | Anthropic | 学習データの収集 |

Google-Extended | Gemini学習用 | |

PerplexityBot | Perplexity | AI検索・回答生成 |

CCBot | Common Crawl | オープンデータセット(多くのAI学習に使用) |

Bytespider | ByteDance | 学習データの収集 |

ターミナルですぐ確認できるコマンド:

# NginxのログからAIボットを探す

grep -iE “GPTBot|ClaudeBot|Google-Extended|PerplexityBot|CCBot|Bytespider|ChatGPT-User” /var/log/nginx/access.log

# どのAIボットが何回来たか集計

grep -ioE “GPTBot|ClaudeBot|Google-Extended|PerplexityBot|CCBot|Bytespider” /var/log/nginx/access.log | sort | uniq -c | sort -rn

NOTE

ホスティングサービス(Vercel・Netlifyなど)を使っている場合は、ダッシュボードのAnalyticsやFunctionsログでUser-Agentをフィルタリングできます。Cloudflareを使っているなら、AI Audit機能(無料)でAIボットのトラフィックを視覚的に確認できます。

② AIに直接聞いてみる

-

難易度:⭐(誰でも可能)

-

コスト:無料

-

ChatGPT・Claude・Gemini・Perplexityなどに自分のサイトについて具体的に質問してみれば、そのAIが自分のコンテンツを知っているかどうかを間接的に確認できます。

テスト方法:

-

「knowai.comというサイトについて知っていますか?」と聞いてみる

-

自分のサイトにしかない固有の表現や文章を検索してみる

-

自分のブログ記事の核心内容を要約してもらう

WARNING

NO ー AIが自分のコンテンツを「知っている」からといって、必ずしも直接クローリングされたわけではありません。

Common Crawlのような公開データセットを通じて間接的に学習した可能性もあります。逆に「知らない」と答えても、学習に使われていないという保証はありません。学習はされていても回答に反映されないこともあるためです。

③ オンラインのクローラーアクセス検査ツール

-

難易度:⭐(誰でも可能)

-

コスト:無料

-

サーバーログにアクセスできない場合、外部ツールで自分のサイトのrobots.txt設定状況とAIボットのアクセス可否を確認できます。

おすすめツール:

-

MRS Digital AI Crawler Access Checker:ドメインを入力するだけで、GPTBot・ClaudeBot・PerplexityBotなどがブロックされているかをすぐ確認

-

Cloudflare AI Audit(無料プラン含む):Cloudflareを使っているサイトなら、どのAIボットが実際に訪問したか、robots.txtを遵守しているかをダッシュボードで確認可能

-

Cloudflare「AIスクレイパー・クローラー」ワンクリックブロック:無料プランでもトグル一つで全AIボットをブロック可能

④ 公開学習データセットで自分のサイトを検索

-

難易度:⭐⭐(検索スキルが必要)

-

コスト:無料

-

多くのAIモデルがCommon Crawlのような公開データセットを学習に使っています。自分のサイトがこのデータセットに含まれていれば、高い確率で複数のAIモデルの学習に使われている可能性があります。

NOTE

Common Crawlとは?

2007年にGil Elbazが設立した米国の501(c)(3)非営利財団で、従業員10名未満の小規模な組織です。毎月数十億の公開Webページを CCBotで収集し、ペタバイト規模のアーカイブをAmazon S3で無料公開しています。「Webデータの民主化」がミッションで、データを販売する営利サービスではなく、公共財としてのWebデータを提供する財団です。

OpenAI(GPT)・Google(Gemini)・Meta(LLaMA)・Anthropic(Claude)など、ほぼすべての主要AI企業がこのデータをLLM学習に活用してきました。ただし2025年にThe Atlanticが「Common Crawlが有料記事まで収集してAI企業への抜け道を開いている」と報じて物議を醸しました。

確認方法:

-

Common Crawl Index(index.commoncrawl.org):自分のドメインを検索すると、Common Crawlが収集したページの一覧と日付を確認できる

-

Have I Been Trained?(haveibeentrained.com):画像がAI学習データセット(LAIONなど)に含まれているか確認するツール(画像クリエイターに有用)

⑤ 行動ベースのボット検知

-

難易度:⭐⭐⭐(開発知識が必要)

-

コスト:無料〜有料

-

User-Agentを偽装するボットまで検知するには、単純なログ分析を超えた行動パターンの分析が必要です。

検知のシグナル:

-

異常なリクエストパターン:短時間に数十〜数百ページを連続リクエスト

-

マウス・スクロールなしのページロード:ブラウザを模倣しているがユーザー操作がない

-

JavaScriptが実行されない:単純なHTTPリクエストでHTMLだけ取得

-

同一IPから繰り返すサイト全体のスキャン

活用ツール:

-

Cloudflare Bot Management:機械学習ベースで偽装ボットも検知

-

サーバーログ+シンプルなスクリプト:リクエスト頻度・IP別ページ数・User-Agentパターンを集計するPython/Bashスクリプトでも基本的な検知が可能

NOTE

個人や小規模チームなら①〜④を組み合わせるのが現実的です。

- Cloudflare無料プランを適用すれば、AIボットのトラフィック確認+ワンクリックブロックが可能

- サーバーログを定期的にチェックすれば、どのボットが来ているか把握できる

- AIに直接聞いてみるだけでも、自分のコンテンツの露出状況を素早く確認できる

- Common Crawl Indexで自分のドメインを検索すれば、公開データセットへの収録状況がわかる

ただし、「AIが私のデータで学習したか」を100%正確に証明する方法は現在存在しません。

AI企業は学習データのリストを公開しておらず、モデル内部で特定データの貢献度を追跡する技術もまだ研究段階です。

6. 実践チェックリスト

Step 1:AI利用方針の整理

-

AIが使ってもいいコンテンツの範囲を定義(例:ブログ・ヘルプセンター・公開ドキュメント)

-

AIが使ってはいけないコンテンツの範囲を定義(例:有料講座・会員限定・個人情報)

Step 2:ai.txtの作成とアップロード

-

テンプレートをもとにai.txtの草案を作成

-

UTF-8エンコードで保存

-

サイトのルートにアップロード →

https://ドメイン/ai.txtでアクセス確認 -

robots.txtと矛盾がないかクロスチェック

Step 3:llms.txtの作成とアップロード

-

H1見出し+blockquoteサマリー+セクション別リンクリストを作成

-

すべてのリンクが実際に開けるか確認(404がないか)

-

https://ドメイン/llms.txtでアクセス確認

Step 4:定期的な更新プロセス

-

利用規約・プライバシーポリシー変更時はai.txt / llms.txtも同時に更新

-

Last-Updatedの日付を必ず更新

7. GEO(Generative Engine Optimization)基礎

7-1. GEOとは?

GEO(Generative Engine Optimization)とは、ChatGPT・Claude・Gemini・Perplexityのような生成AI検索エンジンで自分のコンテンツがより多く発見・引用されるよう最適化する戦略です。

-

従来のSEO=GoogleなどのランキングをKW・バックリンク中心で最適化

-

GEO=AIが回答を生成するときに自分のコンテンツをソースとして選ばせる最適化(文脈・信頼性中心)

-

類似用語:AEO(Answer Engine Optimization)、AI SEO

7-2. SEO vs GEO の核心的な違い

| 項目 | SEO | GEO |

|---|---|---|

| 最適化の対象 | Google・Bingなどの検索エンジン | ChatGPT・Perplexityなどのエンジン |

| 結果の形式 | リンク一覧(ブルーリンク) | AIが生成した総合回答(+出典引用) |

| 重要な要素 | キーワード・バックリンク・ドメイン権威 | 文脈理解・情報の信頼性・構造化データ |

| コンテンツ | キーワード中心 | 定量的・具体的・文脈中心 |

| ユーザーの行動 | 検索→クリック→サイト訪問 | 質問→AIの回答で解決(訪問不要なことも) |

7-3. AIが「良いコンテンツ」と判断する基準

-

意味の理解:単語そのものより文脈と意図を把握

-

情報の統合:複数のソースの情報を組み合わせて包括的な回答を生成

-

信頼性の評価:情報の正確性と出典の信頼度を判断

-

最新性の考慮:新しい情報ほど重みを与える

7-4. GEOの核心戦略

- 構造化されたコンテンツの作成

- 明確な見出し(H1〜H3)の階層構造を使う

- Q&A(質問と回答)形式を積極的に活用する

- 重要な内容を先に書く(逆ピラミッド構造)

- 定量的・具体的な表現を使う

- ❌ 「私たちは優れた技術力を持っています」

- ✅ 「2024年基準で月間エネルギー消費を18%削減しました」

- E-E-A-Tの強化(経験・専門性・権威性・信頼性)

- 著者情報と専門性を明示する

- データ・統計・研究結果を引用する

- 出典を明確に記載する

- 技術的な基盤を整える

robots.txt:AIボットのクローリングを許可する設定ai.txt:AI利用ポリシーを明示llms.txt:重要ドキュメントのリストを提供- 構造化データ(Schema.org)マークアップを活用

- マルチプラットフォームでの存在感を確保

- Wikipedia・LinkedIn・業界フォーラムなどでブランドへの言及を増やす

- 信頼できる多様なソースからの引用を獲得する

今日のまとめ

-

クローリングは検索エンジン・AIがWebを読み込むプロセスであり、AI時代には制御と活用の両方を同時に考える必要があります

-

robots.txt(入場ルール)+ai.txt(利用案内)+llms.txt(重要ドキュメント案内書)で多層的な防御が可能です

-

法的拘束力はまだ限定的ですが、明確な意思表示は紛争の際に決定的な差を生みます

-

GEOはAI検索で自分のコンテンツが引用されるようにする新しい戦略です

-

完全な防御は不可能ですが、何もしないことと準備することは全く違います

NOTE

NOW ー 今すぐやってみましょう

- 自分のサイトの

robots.txtを開いて、AIボット関連の設定があるか確認してみましょう - Common Crawl Indexで自分のドメインを検索してみましょう

- ChatGPTやClaudeに「[自分のサイト]について知っていますか?」と聞いてみましょう

この3つをやってみるだけで、今の自分のサイトがAIにどう見えているかを把握できます。