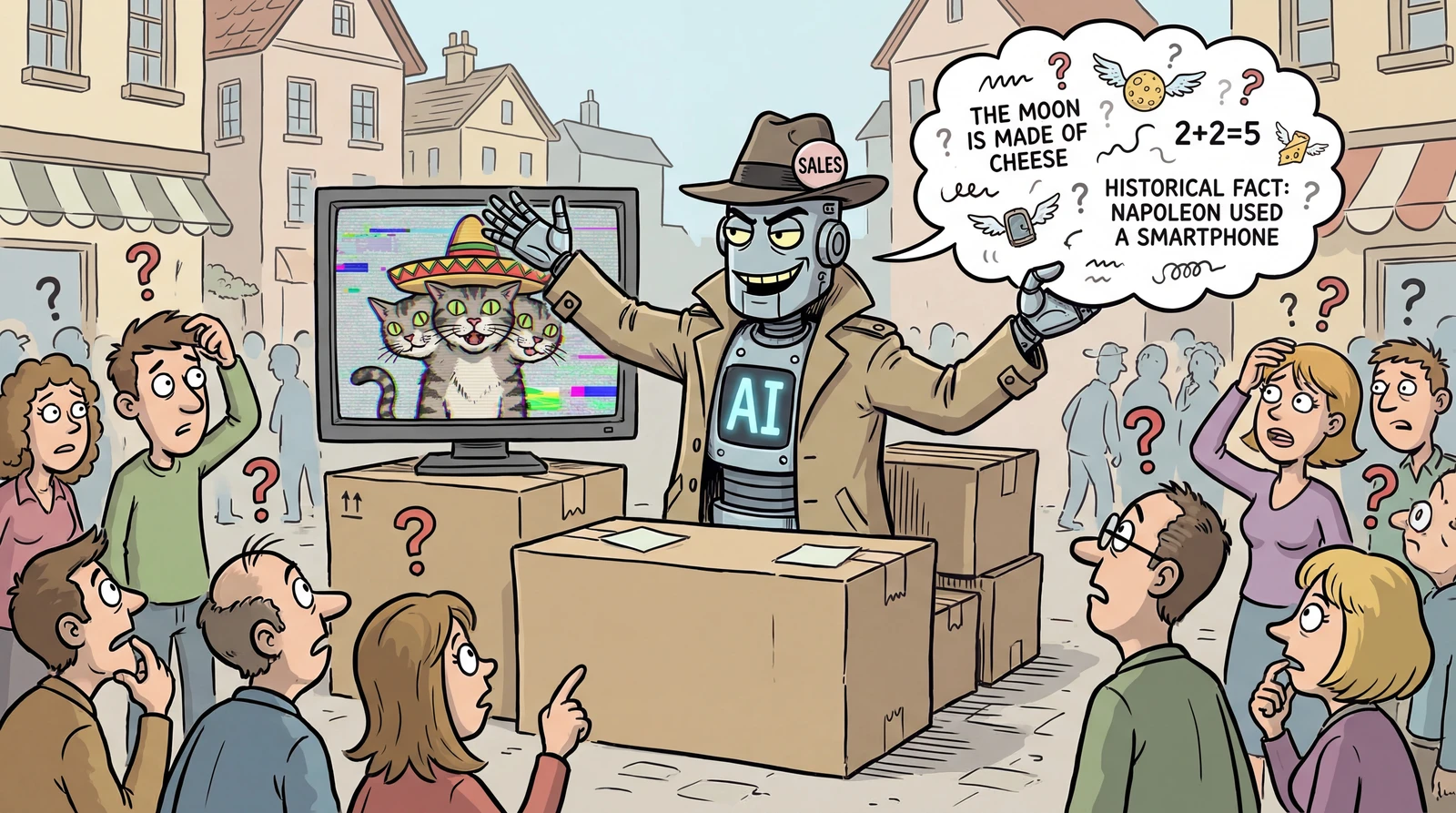

AIはなぜ自信満々に嘘をつくのか?

AIに質問したとき、存在しない情報をもっともらしく引用されたり、でたらめを自信たっぷりに答えられたりした経験はありませんか?

これがまさにAIハルシネーションです。

今回は、ハルシネーションとは何か、なぜ起こるのか、2026年時点でどこまで改善されたのか、そして私たちにできる対策を一緒に見ていきましょう。

list目次expand_more

- 1. ハルシネーションとは?

- 代表的なハルシネーションの種類

- 2. なぜハルシネーションが起こるのか?

- ① AIは「真実」を知らない

- ② 学習データそのものが不完全

- ③ 質問があいまいだと、AIは「それっぽく埋める」

- ④ 「わかりません」と言うように訓練されていない

- ⑤ 口は達者だが、中身が正しいとは限らない

- ⑥ 会話が長くなるほどミスが増える

- 3. 2026年最新:AIモデル別ハルシネーション水準

- 3-1. Vectaraハルシネーション・リーダーボード

- 3-2. その他の評価結果

- 4. ハルシネーションを減らすコツ

- ① 具体的に質問する

- ② 参考資料を直接渡す

- ③ 「わからなければわからないと言って」と伝える

- ④ まとめて聞かず、分けて質問する

- ⑤ AIの回答をうのみにしない

- 5. 今後の見通し

- 5-1. 着実に改善が進んでいる

- 5-2. とはいえ「完璧」にはまだ遠い

- 6. 今日のまとめ

- 7. 参考資料

1. ハルシネーションとは?

AIが「幻覚(Hallucination)」を見るという比喩から生まれた用語です。

人間の幻覚が実際には存在しないものを見てしまうように、AIも実際には存在しない情報を、さも事実であるかのように生成してしまうのです。

代表的なハルシネーションの種類

-

でっち上げ :「この店はミシュラン二つ星ですよ」と自信たっぷりに言うが、実際にはミシュランに掲載されたことすらない店

-

事実の混同 :「この映画は2022年公開で、アカデミー作品賞を受賞しています」と言うが、公開年や受賞歴がデタラメ

-

的外れなおすすめ :「この薬は頭痛によく効きます」と言ったが、実際にはまったく別の用途の薬

-

画像の不具合 :AIが生成した画像で指が6本あったり、看板の文字が意味不明に崩れたりする現象

WARNING

2025年1月、アメリカ・ミネソタ州の連邦裁判所で奇妙な判決が下されました。「AIと虚偽情報の危険性」をテーマにした専門家報告書が裁判所に提出されたのですが、判事が確認したところ、報告書に引用された論文がすべて存在しないものでした。ChatGPTが作り出した架空の論文だったのです。裁判所はその提出物を却下し、判決文にこう記しました。

“The irony.”(皮肉なことに)

このように、AIは「わかりません」と言う代わりに、もっともらしい答えを作り出してしまう傾向があります。

2. なぜハルシネーションが起こるのか?

AIが「嘘」をつく理由を理解するには、まずAIの仕組みを知る必要があります。

① AIは「真実」を知らない

オウムは人の言葉を聞いてそっくりそのまま真似します。発音も正確で、イントネーションも自然です。でも、オウムは自分が話している言葉の意味を理解していません。AIも同じです。

AIはインターネット上の膨大なテキストを読み込み、「この言葉の次にはこの言葉がよく来る」というパターンを学習したものです。たとえば「日本の首都は?」と聞くと、無数の文章で「日本」「首都」の後に「東京」が続くパターンを知っているから「東京」と答えます。

この仕組みは、よく知られた知識ほど驚くほど正確です。

しかし重要なのは、AIが事実かどうかを検証して答えているのではなく、統計的に「それっぽい」言葉を並べているにすぎないという点です。だからこそ、学習データが乏しいテーマや込み入った質問では、もっともらしいけれど間違った答えを生み出してしまうのです。

② 学習データそのものが不完全

AIはインターネット上の文章から学びます。しかし、ネット上には

-

正確なニュース記事もあれば、間違いだらけのブログ記事もあり

-

専門家の解説もあれば、根拠のない口コミやデマもあります

AIはこれらをすべて区別なく学習します。 図書館で、査読済みの専門書と誰かが紛れ込ませたいい加減な本を区別せずに読んでしまうようなものです。

③ 質問があいまいだと、AIは「それっぽく埋める」

「おすすめのお店教えて」と聞かれても、AIにはあなたがどこに住んでいるのか、どんな料理が好きなのか、予算はいくらなのかがわかりません。ただ空白をそれっぽい情報で埋めてしまうだけです。これがハルシネーションの最も多い原因です。

④ 「わかりません」と言うように訓練されていない

AIは開発の過程で「良い回答をすれば高いスコアがもらえる」という仕組みで学習されています。

そのため、わからないことでもなんとか答えようとする癖があります。人間にたとえると、テストで空欄を残したくなくて、とりあえず何か書いてしまうのと同じです。

⑤ 口は達者だが、中身が正しいとは限らない

AIは自然で自信に満ちた文章を生成するよう訓練されています。

問題は、間違った内容でも非常に流暢に語ってしまうこと。人間だって、堂々と話す人のほうを信用しがちですよね? AIも同じで、間違いを確信ありげに述べるため、つい信じてしまいやすいのです。

⑥ 会話が長くなるほどミスが増える

AIと長くやり取りするほどハルシネーションが増えると感じたことはありませんか? これは偶然ではなく、AIの構造的な理由があります。

-

前の会話を忘れる :やり取りが長くなるとAIの「記憶容量」がいっぱいになり、最初に伝えた条件や前提を見失い始めます。2時間の会議で、冒頭の話を終盤にはすっかり忘れているようなものです。

-

小さなミスが雪だるま式に膨らむ :序盤でAIがわずかに間違えた情報をもとに、後半もそのまま回答を続けると、誤りがどんどん積み重なっていきます。

-

注意力が分散する :AIは会話のすべてに「注意(Attention)」を配分しなければなりません。会話が長くなるほど一つひとつに割ける注意力が減り、大事な文脈を見落として的外れな回答をする確率が高まります。

NOTE

会話が長くなってきたなと思ったら、新しいチャットを開いて、要点を整理し直してから再スタートしましょう。これだけでもハルシネーションをぐっと減らせます。

3. 2026年最新:AIモデル別ハルシネーション水準

ハルシネーションは測定方法によって数値が大きく変わります。

3-1. Vectaraハルシネーション・リーダーボード

与えられた文書を要約する際に、原文にない内容をどれだけ作り出してしまうかを測定します。

| AIモデル | ハルシネーション率 |

|---|---|

| Google / Gemini 2.5 Flash Lite | 3.3% |

| OpenAI / GPT 4.1 | 5.6% |

| xAI / Grok 3 | 5.8% |

| OpenAI / GPT 5.4 | 7% |

| Google / Gemini 2.5 Pro | 7% |

| Google / Gemini 2.5 Flash | 7.8% |

| Google / Gemini 3.1 Flash Lite | 8.2% |

| OpenAI / GPT 4o | 9.6% |

| Anthropic / Claude Sonnet 4 | 10.3% |

| Google / Gemini 3.1 Pro | 10.4% |

3-2. その他の評価結果

上記のVectaraリーダーボードは「文書要約」タスク基準のため、ハルシネーション率は低めに出ます。しかし、自由な質疑応答の場面では結果がかなり異なります。

-

AIMultipleベンチマーク:37のAIモデルに60問のテストを実施したところ、最新モデルでも15%以上がハルシネーション。法律分野では約18.7%、医療分野では約15.6%の誤りが確認されました

-

AA-Omniscience ベンチマーク:高難度の知識問題において、ほとんどのAIが、正答よりもハルシネーションを多く生成

4. ハルシネーションを減らすコツ

ハルシネーションを完全になくすことはできませんが、ぐっと減らす方法はあります。

① 具体的に質問する

-

ダメな例:「東京旅行について教えて」

-

良い例:「4月上旬に東京へ3泊4日で旅行するんだけど、お花見スポット中心でプランを立てて。予算はひとり10万円くらい。」

質問が具体的であるほど、AIが“創作”する余地が減ります。

② 参考資料を直接渡す

AIに回答のもとになる情報を直接渡すことができます。たとえば:

「この記事の内容だけをもとに要約して」(記事のURLやテキストを一緒に貼り付ける)

こうすれば、AIが勝手に情報をでっち上げるのを大幅に防げます。

③ 「わからなければわからないと言って」と伝える

「確実でない内容には『要確認』と付けて、出典も教えて」

この一言を添えるだけで、AIが無理やり答えをひねり出す代わりに、出典付きで正直に回答してくれる確率がぐんと上がります。

④ まとめて聞かず、分けて質問する

複雑な質問をまとめて投げるとミスが起きやすくなります。ステップを分ければ、途中でおかしな部分に気づけます。

⑤ AIの回答をうのみにしない

AIが教えてくれたお店、薬の情報、歴史的事実など大事な内容は、必ずGoogle検索や公式サイトでダブルチェックしてください。

5. 今後の見通し

5-1. 着実に改善が進んでいる

AIのハルシネーションは確実に減ってきています。

-

「この文書を要約して」のようなタスクでは、ハルシネーション率が1%未満にまで下がりました。参考資料を渡しさえすれば、でたらめを言うことはほぼなくなったのです。

-

AIモデルは世代を重ねるごとに精度が向上しており、2025年末〜2026年初頭に登場したGPT-5.2やOpus 4.5といった最新モデルでは目に見えて精度が上がっています。

5-2. とはいえ「完璧」にはまだ遠い

率直に言えば、ハルシネーションを完全にゼロにするのは現時点では不可能です。

AIが「次に来る単語を予測する」という仕組みで動いている以上、たまに間違えるのはこの技術の本質的な特性だからです。

-

一部の専門家は、2027年頃には「大半の場面で気にならないレベル」に達すると予測しています。

-

一方で、「2023年にも“もうすぐ解決する”と言われていたのに、いまだ完全ではない」と楽観論を戒める研究者もいます。

だからこそ、現実的なゴールは「ゼロにすること」ではなく「十分に減らすこと」。

AIは優秀なパートナーですが、人間と同じようにたまにミスをします。その前提を忘れずに活用しましょう。

6. 今日のまとめ

-

AIは「知っている」のではなく「予測している」 :自信たっぷりの回答=正確な回答、とは限りません

-

場面によって信頼度は変わる :文書要約なら誤り1%未満、自由質問では15%超の誤り

-

具体的に聞く・根拠を渡す・ダブルチェックする :使う側の習慣こそ最強の防御策

-

AIはパートナーであって、万能の神託ではない :最終判断はいつだって人間の仕事

7. 参考資料

-

Short Circuit Court: AI Hallucinations in Legal Filings and How To Avoid Making Headlines: https://www.coleschotz.com/news-and-publications/short-circuit-court-ai-hallucinations-in-legal-filings-and-how-to-avoid-making-headlines/

-

Vectara Hallucination Leaderboard:huggingface.co/spaces/vectara/leaderboard

-

AIMultiple、AI Hallucination: Compare top LLMs (2026.01):aimultiple.com/ai-hallucination

-

Artificial Analysis、AA-Omniscience Knowledge & Hallucination Benchmark:artificialanalysis.ai/articles/aa-omniscience-knowledge-hallucination-benchmark

-

Suprmind、AI Hallucination Rates & Benchmarks in 2026:suprmind.ai/hub/ai-hallucination-rates-and-benchmarks

-

Suprmind、AI Hallucination Statistics: Research Report 2026:suprmind.ai/hub/insights/ai-hallucination-statistics-research-report-2026